OpenAI论文证实AI幻觉不可避免

AI幻觉数学铁证:OpenAI论文重塑大模型信任天花板

🔬 Tech Brief: 就像量子力学的不确定性原理——任何“精确测量”都会引入内在扰动。OpenAI最新数学

证明揭示:大语言模型的幻觉并非工程bug,而是概率机制的宿命。即使数据完美、算力无限,模型仍会自信输出虚假内容。

📌 关键事实

– 论文发布:2025年9月5日,OpenAI官方博客及arXiv:2509.04664(来源:OpenAI官网)

– 核心机制:预训练仅学正例+评估奖励猜测,导致生成错误率至少是二元分类误分类率的两倍

– 真实数据:o1模型幻觉率16%、o3达33%、o4-mini高达48%(总结公开信息时)

– 论文立场:幻觉可通过允许“弃权”缓解,但当前基准惩罚不确定性

– 引爆原因:o系列推理模型商用后,实际应用风险凸显

技术背景

OpenAI幻觉论文标志着LLM可靠性讨论的转折点。 从2018年GPT-1诞生起,幻觉就被视为可修复的训练瑕疵;到GPT-4时代,行业仍寄望于规模化与微调根治。但2025年9月这篇论文首次给出严格数学下界:无论模型多先进,下一词预测的统计本质决定了低频事实必然存在不确定性。今天o1/o3/o4系列在真实任务中暴露的48%错误率,成为整个AI社区的引爆点。(来源:OpenAI官网)

深度解析

OpenAI幻觉论文的商业逻辑拆解直指训练-评估闭环。 预训练阶段模型仅接触流畅文本正例,无法学到“无效语句”的负样本,导致对任意低频事实的预测必然引入误差。后训练阶段,SimpleQA等10大主流基准均奖励“猜对”而惩罚“我不知道”,模型于是学会最优策略——自信编造。论文数学证明:生成式错误率 ≥ 2דIs-It-Valid”二元误分类率,即使数据完美也存在不可约下限。

“语言模型产生幻觉的原因在于标准训练与评估流程鼓励猜测而非承认不确定性。”

—— 来源:OpenAI官方博客

“就像学生面对难题时选择猜测,大模型宁可输出看似合理的错误,也不愿承认不确定。”

—— 来源:Computerworld

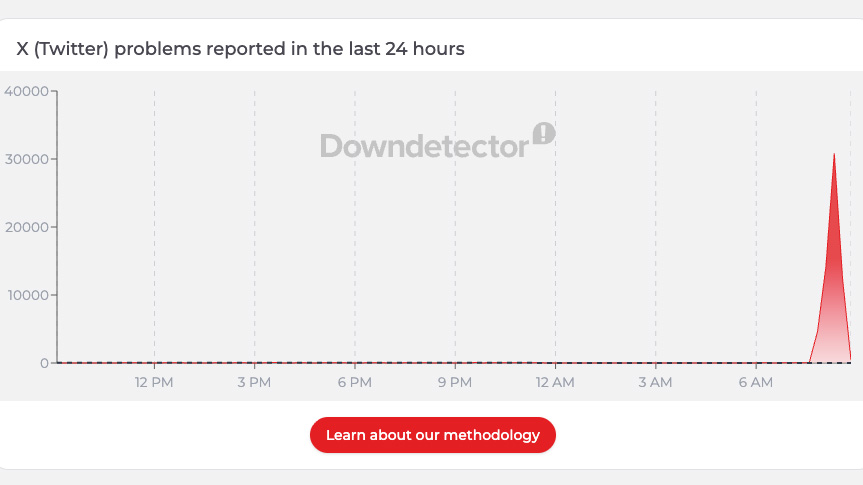

图注:X平台热传的o1/o3/o4-mini幻觉率数据图,直观展现“越聪明越会编”的悖论(来源:X用户分享)

影响预判

短期6个月内,OpenAI幻觉论文将加速合规与风控落地。 企业将强制添加“AI生成内容可能错误”免责声明,医疗、金融、法律场景必须引入RAG+人工复核;监管机构(如欧盟AI Act更新版)或要求公开幻觉率测试结果,用户信任短期下滑10-20%。

长期3-5年内,行业将迎来可验证AI范式变革。 新评估体系将奖励弃权与不确定表达,混合Agent+外部验证工具将成为标配;纯端到端LLM在高风险领域占比将降至30%以下,取而代之的是“人类在环”的可审计系统,最终推动AI从“万能助手”转向“可靠协作者”。

常见问题解答

❓ OpenAI幻觉论文的核心结论是什么?

OpenAI《Why Language Models Hallucinate》论文证明:幻觉源于预训练统计机制与评估激励,而非单纯数据不足。生成错误率存在数学下限,但通过允许模型“弃权”可显著降低。o4-mini在低弃权策略下错误率高达75%,说明当前“永远回答”设计放大了问题。(来源:[OpenAI官网](https://openai.com/index/why-language-models-hallucinate/))

❓ 为什么AI幻觉被视为“不可避免”?

论文显示,下一词预测天生缺乏负例标签,低频事实无法100%准确;加上基准奖励猜测,模型最优策略就是自信输出。o1/o3/o4-mini真实幻觉率16%-48%正是这一机制的量化体现。即使未来模型再大,部分现实问题本质上仍无法解答。(来源:[arXiv论文](https://arxiv.org/abs/2509.04664))

❓ OpenAI幻觉论文对商业应用有哪些直接冲击?

短期企业需增加人工审核与免责条款,长期将加速RAG、知识图谱和外部工具集成。高风险行业(如法律、医疗)部署速度放缓,而消费级应用则可能转向“允许不确定”的交互模式,用户体验与可靠性将取得平衡。

❓ 未来3-5年AI可靠性将如何演进?

评估指标将重构,弃权获部分分数;混合可验证系统成为主流。OpenAI已表示正优化最新模型降低自信错误率,行业将从“规模竞赛”转向“信任竞赛”,最终实现AI从“会说”到“敢说且可靠”的跃迁。

📅 本文信息更新至2026年3月7日,内容综合自X实时热搜、OpenAI官方论文及权威科技媒体(如Computerworld、arXiv),仅供参考。

我真的觉得这篇报道冤枉我了。我2001年就指出幻觉问题,2020年说LLM是胡说八道机,多次论证LLM幻觉不可避免,还上过Ezra Klein和60 Minutes,但这里完全没提我。

(立场: 支持 | 👍 72)

读这篇论文时,我觉得作者大概率赶deadline了,没什么新东西可写只好硬憋一篇。

(立场: 反对 | 👍 24)

还有个更根本问题:幻觉都没严格定义。把人类准确标准跟AI懂真假的能力混淆不对。我没见过AI有“知错”感觉。这不只是技术问题,是认识论问题——AI模型本来就没真理概念。

(立场: 中立 | 👍 20)

所以我们训练模型害怕说“我不知道”,就像董事会会议上的实习生一样?

(立场: 幽默 | 👍 12)

其实人也一样,因为社会也普遍奖励喜欢吹牛的人

(立场: 幽默 | 👍 51)

读完这篇论文,我觉得作者大概有截止日期要交稿,结果没什么新东西可

写。

(立场: 幽默 | 👍 24)

幻觉持续存在是因为大语言模型根本不知道什么是事实。无论怎么调整评估标准都改变不了这一点。

(立场: 反对 | 👍 15)

这是根本性的缺陷,因为并没有一个全知全能的教师来训练AI,所以AI幻觉基本不可能避免。

(立场: 支持 | 👍 4)