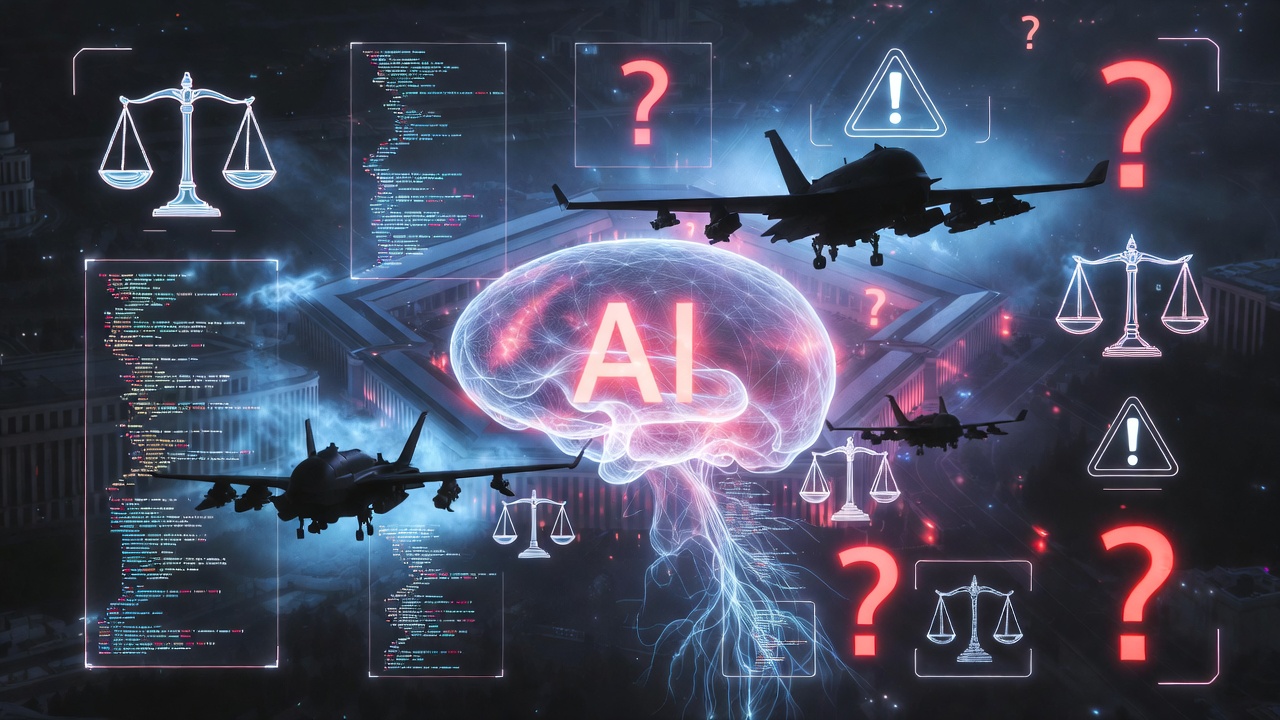

当AI面临战场抉择:五角大楼AI争议中的人性底线

当AI面临战场抉择:五角大楼AI争议中的人性底线

🧡 编辑按: 在国家安全与技术良知之间,这场AI Pentagon争议提醒我们:技术再强大,也无法取代人类对生命的敬畏与责任。

📌 关键事实

– 事件时间:2026年1月五角大楼发布AI加速战略,2月底谈判破裂,3月5日Anthropic收到供应链风险通知。

– 核心主体:AI公司Anthropic拒绝移除Claude模型对“大规模美国公民监控”和“完全自主武器”的限制;五角大楼要求“所有合法用途”。

– 关键数据:Anthropic曾是唯一部署于五角大楼机密网络的AI供应商,此争议或导致数亿美元合同流失。

– 舆论影响:X平台专家热议军事AI安全与道德,引发科技政策跨界辩论。

– 最新进展:Anthropic已正式挑战该决定,承诺过渡期继续支持前线作战人员。

事件还原

2026年初,美国国防部推出AI加速战略,要求合作企业AI模型支持所有合法军事用途。(来源:Anthropic官方声明)

Anthropic坚持两条红线:禁止用于美国公民大规模监控,以及开发无需人类介入的完全自主武器。双方谈判持续数月后破裂,五角大楼于3月初将Anthropic正式列为“供应链风险”,并要求六个月内逐步淘汰其技术。(来源:AP News)

3月5日,Anthropic公开回应并表示将通过法律途径挑战此举。目前争议已从合同纠纷升级为AI军事应用伦理的公开对峙。

🎥 相关视频: Pentagon officials send Anthropic best, final offer for military use of its AI

来源:CBS News

深度评论

这场AI Pentagon争议的根源在于制度与文化的结构性冲突:国防部追求AI在战场的绝对主导权,而科技企业则坚守伦理防护以避免技术失控。

Anthropic的创始团队多为担忧AI风险的前OpenAI成员,他们的处境代表了众多AI工程师的内心挣扎——既想为国家安全贡献力量,又不愿让代码成为无情杀戮的工具。

五角大楼首席技术官Emil Michael公开表示:“我需要一个可靠的合作伙伴,不会中途崩溃。”而Anthropic则强调当前AI可靠性不足以支撑完全自主决策。

“我们无法昧着良心同意他们的要求……前沿AI系统还不够可靠,无法为完全自主武器提供动力。”

—— Dario Amodei,Anthropic CEO(来源:Anthropic官网)

X平台上,专家如Jim Sciutto和Mehdi Hasan的讨论迅速发酵,舆论焦点集中在“私企是否有权设定军事AI红线”这一核心争议上。

反思与呼吁

面对AI军事化加速,我们亟需建立政府、企业与公众共同参与的透明治理框架,推动国际自主武器公约的落地。

值得追问的是:当技术已能自主“决定生死”时,人类该如何确保道德判断始终握在自己手中?唯有跨界对话与制度约束,才能让AI真正成为守护而非威胁的力量。

常见问题解答

❓ 这场AI Pentagon争议的来龙去脉是什么?

2026年1月五角大楼发布AI加速战略,要求AI用于所有合法军事用途。Anthropic因伦理顾虑拒绝移除对完全自主武器和国内监控的限制,导致3月初被列为供应链风险并提起法律挑战。事件源于最新AI模型军事合同谈判破裂。

❓ 为什么Anthropic拒绝五角大楼的要求?

Anthropic认为前沿AI模型可靠性不足以支撑完全自主致命武器,且大规模监控美国公民与民主价值冲突。公司CEO强调“无法昧着良心”移除安全防护,仅保留这两条高层次红线。

❓ 此争议为什么引发广泛关注?

它直接暴露了国家安全需求与AI伦理守护之间的张力,涉及数亿美元国防合同,并引发全球对自主武器误判风险的担忧。X平台专家讨论进一步放大了社会影响。

❓ 未来AI军事伦理将如何发展?

预计将推动更多立法、国际规范制定以及三方协商机制。核心趋势是确保人类始终掌握最终决策权,避免AI失控酿成不可逆的人道后果。

📅 本文信息更新至2026年3月10日,内容综合自X实时热搜及Anthropic官方声明、AP News、CBS News等权威媒体报道,仅供参考。

Anthropic告诉五角大楼:“我们不会给你们造监控引擎或自主杀伤链”,特朗普却骂他们是国家安全威胁。真正的国家安全威胁,是需要AI高效监视自己公民的政府!

(立场: 反对 | 👍 1.2k)

这里不对劲。五角大楼要“任何合法用途”。大规模监控理论上违法。我觉得争议根本不是自主AI,如果猜的话,实际是上游AI系统指令和防护措施……

(立场: 中立 | 👍 1.2k)

Emil,你发文化敏感培训截图干嘛?真正争议是自主武器和大规模监控!这就像吵引擎安全却扯汽车厂DEI政策,纯属转移视线。

(立场: 幽默 | 👍 960)

不喜欢协议就别签啊,最简单不过。问题是为什么五角大楼因为Anthropic不让用AI造自主武器或监视美国人而发飙?国防部到底想干嘛?

(立场: 反对 | 👍 684)

Anthropic告诉五角大楼:“我们不会给你造监视引擎或自主杀戮链”,特朗普却称他们是国家安全威胁。真正的威胁是需要AI高效监视本国公民的政府。

(立场: 反对 | 👍 1.2k)

五角大楼想要零规则零伦理的AI……这计划太棒了!还能出什么问题呢?

(立场: 幽默 | 👍 381)

这里不对劲。五角大楼要“任何合法用途”。监视理论上非法。争执很可能不是自主AI,而是更广泛的上游AI防护措施。

(立场: 中立 | 👍 1.2k)

真实争议是自主武器和大规模监视,而非培训文件。五角大楼该不该无监督用AI杀戮链才是关键。

(立场: 反对 | 👍 957)