OpenAI机器人高管因AI监控担忧宣布辞职

「AI军事突破」引爆伦理危机:OpenAI 高管辞职 AI监控考验行业底线

🔬 Tech Brief: 就像曼哈顿计划物理学家因原子弹无差别杀伤选择离场,今天OpenAI机器人高管用辞职划出

AI监控与致命武器的“不可逾越”红线。

📌 关键事实

– 事件时间:2026年3月7日,OpenAI机器人与消费硬件负责人Caitlin Kalinowski宣布辞职

– 当事人背景:前Meta硬件高管,2024年11月加入OpenAI领导机器人团队

– 核心原因:担忧OpenAI与五角大楼协议可能导致美国国内无司法监控及致命自主武器滥用

– 直接引语来源:当事人X/LinkedIn帖子明确“surveillance of Americans without judicial oversight and lethal autonomy without human authorization are lines that deserved more deliberation than they got”

– 公司回应:协议坚守“无国内监控、无自主武器”红线(来源:TechCrunch)

技术背景

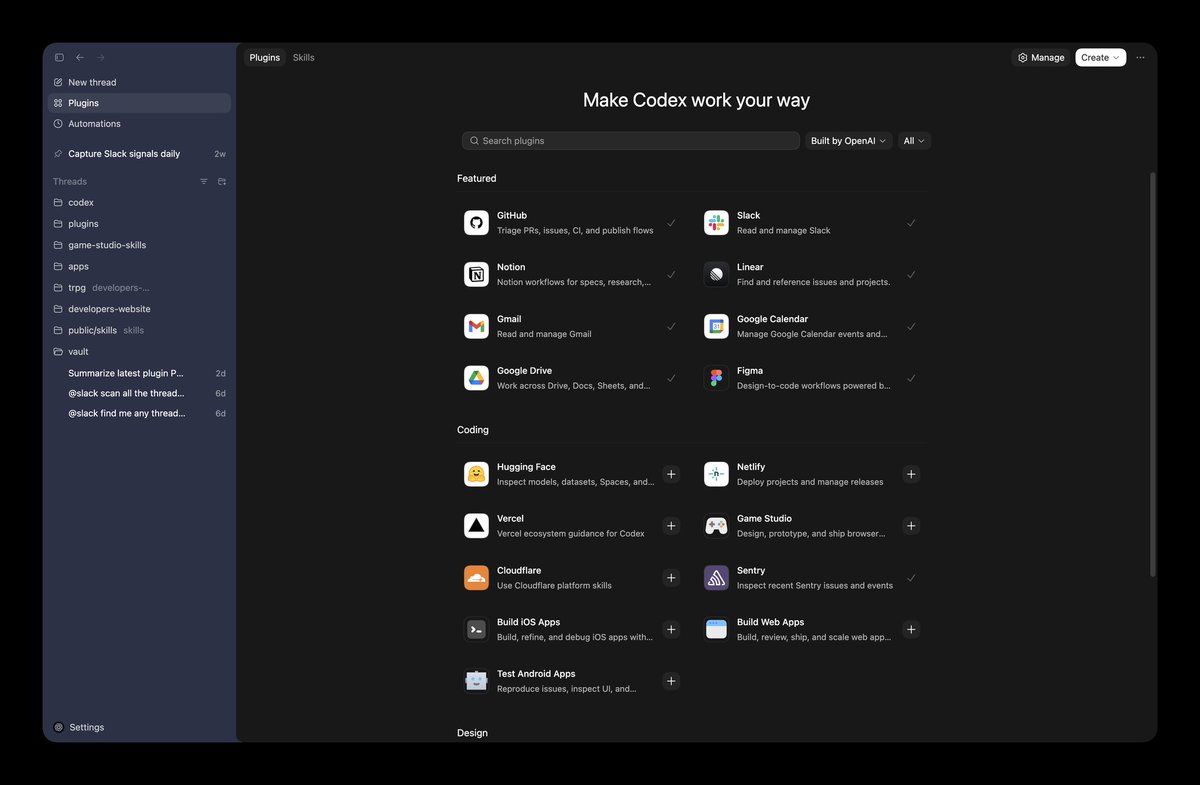

OpenAI 高管辞职 AI监控事件并非孤立,而是AI从消费级ChatGPT快速迈向军事机器人应用的必然碰撞点。2024年11月Caitlin Kalinowski从Meta加入后,OpenAI机器人部门加速硬件-AI融合;2026年2月底公司与国防部达成协议,将模型部署至机密网络,本意赋能国家安全,却因监管缺失在2026年3月7日成为引爆点。(来源:Reuters)

深度解析

OpenAI 高管辞职 AI监控的核心矛盾在于双重用途风险:机器人技术结合大模型可实现高效监视或自主决策,却缺乏司法与人为授权保障。Caitlin Kalinowski凭借Meta AR眼镜项目经验,最先察觉治理缺口。她直言协议“rush without guardrails”,商业逻辑上军方合同虽带来数据与收入,但伦理代价已超内部容忍。

“AI has an important role in national security. But surveillance of Americans without judicial oversight and lethal autonomy without human authorization are lines that deserved more deliberation than they got. This was about principle, not people.”

—— 来源:Caitlin Kalinowski LinkedIn/X声明(2026年3月7日)

影响预判

短期(6个月内):OpenAI 高管辞职 AI监控将引发内部更多异议与人才外流,军用AI项目招聘难度上升,科技圈伦理辩论升温。

长期(3-5年):或推动全球AI武器监管立法加速,安全优先的公司将吸引顶尖人才,而忽视红线的企业面临声誉与政策双重压力,最终重塑AI军事应用行业格局。

常见问题解答

❓ 该事件是什么?OpenAI 高管辞职 AI监控的核心定义

2026年3月7日,OpenAI机器人部门负责人Caitlin Kalinowski因公司与五角大楼AI协议担忧美国国内无司法监控及致命自主武器滥用而辞职。该事件标志AI机器人技术从商业突破进入国家安全伦理争议阶段。

❓ 为什么重要?OpenAI 高管辞职 AI监控对行业有何影响

此举暴露大模型军事化双刃剑:短期引发OpenAI内部动荡,长期倒逼全球制定明确监管框架,避免AI成为“无人类授权杀伤”工具。

❓ 接下来会怎样?AI军事应用趋势预测

3-5年内预计出现国际AI武器公约雏形;OpenAI等公司或强化内部治理红线,人才将向伦理优先企业流动,推动行业从“速度优先”转向“安全优先”。

❓ OpenAI官方如何回应?红线是否真实有效

公司明确“no domestic surveillance and no autonomous weapons”,强调技术+合同双重保障,但Caitlin Kalinowski认为协议公布过于仓促,治理讨论不足。

📅 本文信息更新至2026年3月7日,内容综合自X实时热搜及权威科技媒体(如Reuters、TechCrunch),仅供参考。

抱歉你的妄想,但国会在这里有监督权。像OpenAI或Anthropic这样的公司在美军军事能力这件事上,美国人民和政府的对话里没你们公司什么事。

(立场: 反对 | 👍 550)

哇哦,天哪。很遗憾听到这个,也超级期待你接下来要做什么!

(立场: 支持 | 👍 262)

凯特琳,作为

国家安全从业者,我告诉你你完全不知道自己在说什么,你也没参与过任何政府讨论。只不过是又一个被错误新闻骗的女人,没人在意你辞职。

(立场: 反对 | 👍 190)

好奇想听听(如果你能披露的话),自从和国防部签约后到现在,有多少成员离职了?

(立场: 中立 | 👍 345)

离开诈骗犯Altman是个明智的选择,干得漂亮!

(立场: 幽默 | 👍 78)