英文维基百科全面禁止AI生成文章

维基百科AI禁令冲击:AI内容生成遭遇“人类铁壁”,知识生态格局重塑

🔬 Tech Brief: 就像ChatGPT被禁止直接输出学术论文一样,英文维基百科突然对AI生成文本下达全面禁令——高效工具碰上严苛准确性要求,核心矛盾一触即发。

📌 关键事实

– 事件发生时间:2026年3月23日

– 核心主体:英文维基百科编辑社区(RfC讨论,40余名编辑压倒性支持)

– 政策核心:禁止大型语言模型(LLM)生成或改写条目文本

– 例外规定:仅限自身写作的基本润色(需人工审核)和合格翻译辅助(编辑须精通双语)

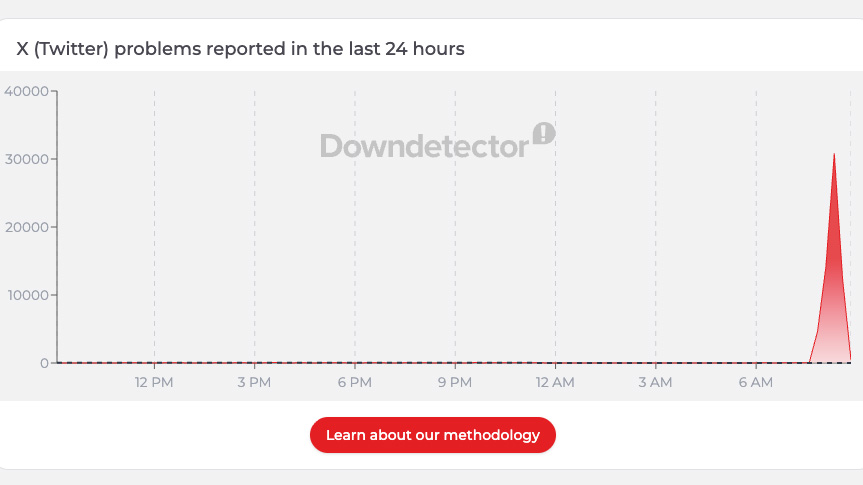

– 曝光来源:X平台Pop Base率先发布,引发科技与内容领域热议

事件还原

英文维基百科正式将“禁止LLM生成或改写条目内容”写入内容指导方针。2026年3月23日,社区RfC讨论以压倒性共识通过新规,取代此前仅针对全新文章的临时占位政策。

新规明确:LLM文本常违反维基百科核心内容政策(如准确性、来源支持),因此严禁直接用于新旧条目。编辑可使用LLM辅助自身写作润色或翻译,但必须人工逐句审核,且不得引入新内容。(来源:Wikipedia官方指导方针)

评论视角

这一维基百科AI禁令直击AI内容生成行业的痛点——追求速度与规模的LLM,在严谨知识平台面前暴露出幻觉与不可验证风险。行业竞争格局因此转向:AI公司必须从“全自动生成”转向“人类主导辅助工具”,否则将被可靠知识源边缘化。

“LLM text has been really frowned upon for a while, but it’s good to have that officially be the case.”

—— Hannah Clover(2024年Wikimedian of the Year)

—— 来源:Reporters’ Lab

Barkeep49补充强调:“It’s important to Wikipedians that our content be written by humans.” 这反映出维基百科对“人类可信度”的战略坚守。

影响预判

短期(6个月内):编辑社区将加速清理现有疑似AI文本,内容检测工具需求激增;AI辅助翻译仍获有限空间,但审核门槛大幅提升,导致新条目产出暂时放缓。

长期(3-5年):维基百科巩固“纯人工主导”权威地位,推动AI企业开发可追溯、可审核的协作工具;整个内容创作生态将形成“人类审核+AI辅助”混合模式,其他知识平台或跟随制定类似维基百科AI禁令,行业整体质量门槛上移。

常见问题解答

❓ 维基百科AI禁令具体是什么?

英文维基百科于2026年3月23日通过新指导方针,禁止使用大型语言模型(LLM)生成或改写任何条目文本。仅允许编辑对自身写作进行基本润色(人工审核)或辅助翻译(编辑须精通语言)。此举旨在防止AI幻觉破坏内容准确性。

❓ 为什么维基百科要实施这一禁令?

LLM生成的文本常违反维基百科准确性、来源支持等核心政策,且易引入不可验证信息。社区认为“AI slop”已泛滥互联网,维基百科必须保持人类编写内容以维护全球最大知识库的可信度。

❓ 这对AI内容创作行业有何影响?

短期内AI生成工具使用受限,编辑审核成本上升;长期促使AI公司转向辅助而非替代人类创作,内容平台将更强调可验证性与人类监督。

❓ 接下来其他平台或语言版维基百科会跟进吗?

英文版率先行动,其他语言版(如西班牙语)已有独立规则。预计3-5年内更多知识平台将制定类似维基百科AI禁令,推动行业向“人机协作”而非“AI全包”转型。

❓ 普通用户或AI开发者如何应对?

开发者应聚焦可审计的辅助工具而非直接生成内容;用户编辑维基百科时需确保所有文本由人类主导,避免违规。维基百科仍欢迎高质量人类贡献。

📅 本文信息更新至2026年3月26日,内容综合自X实时热搜、Wikipedia官方指导方针及权威媒体报道(如Reporters’ Lab、Yahoo Tech),仅供参考。

维基百科不喜欢直接整段删除那种文本,他们更愿意重写和改进它。所以任何带有AI内容的文章,其实就是在向编辑们广播“请把这些AI胡言乱语删掉”。

(立场: 中立 | 👍 841)

哈哈,维基百科现在怕AI了?

(立场: 幽默 | 👍 1)

嗯,AI其实已经在一定程度上造成了懒惰和缺乏真正原创想法。

(立场: 支持 | 👍 0)

维基百科全面禁止AI生成文本,这简直是巨大剧情反转!🤯 创作者和怀疑论者的反应要疯了。2026真的是‘纯人类’对战AI的年份。✨

(立场: 中立 | 👍 0)