波士顿动力Spot机器人集成Gemini AI 巡检能力大幅提升

Spot机器人Gemini AI集成:巡检从脚本执行到自主推理,工业机器人临界突破

🔬 Tech Brief: 传统四足机器人只能按预设脚本巡检,如今Spot机器人Gemini AI加持后,能直接“读懂”手写任务清单、自主解读仪表和环境风险——这一跃升正把机器人从“执行者”推向“决策者”。

📌 关键事实

– 事件时间:2026年4月8日起,Orbit AIVI-Learning正式集成Gemini Robotics-ER 1.6并上线

– 核心主体:波士顿动力Spot机器人与Google DeepMind合作

– 关键升级:支持复杂仪表阅读、液体泄漏检测、5S合规审计、视镜液位0-100%测量及托盘计数

– 演示亮点:Spot可通过摄像头解读手写待办清单,自主规划并执行任务(来源:Boston Dynamics官方博客)

– 性能提升:Gemini Robotics-ER 1.6通过agentic vision实现仪表阅读高精度,显著优于1.5版本

事件还原

2026年4月8日,波士顿动力正式宣布其Orbit软件平台的AIVI-Learning功能已全面切换至Google DeepMind的Gemini Robotics-ER 1.6模型。该集成直接应用于Spot机器人及其云端管理系统Orbit,使机器人无需重新编写状态机代码,即可通过自然语言提示完成更高阶视觉分析和任务推理。

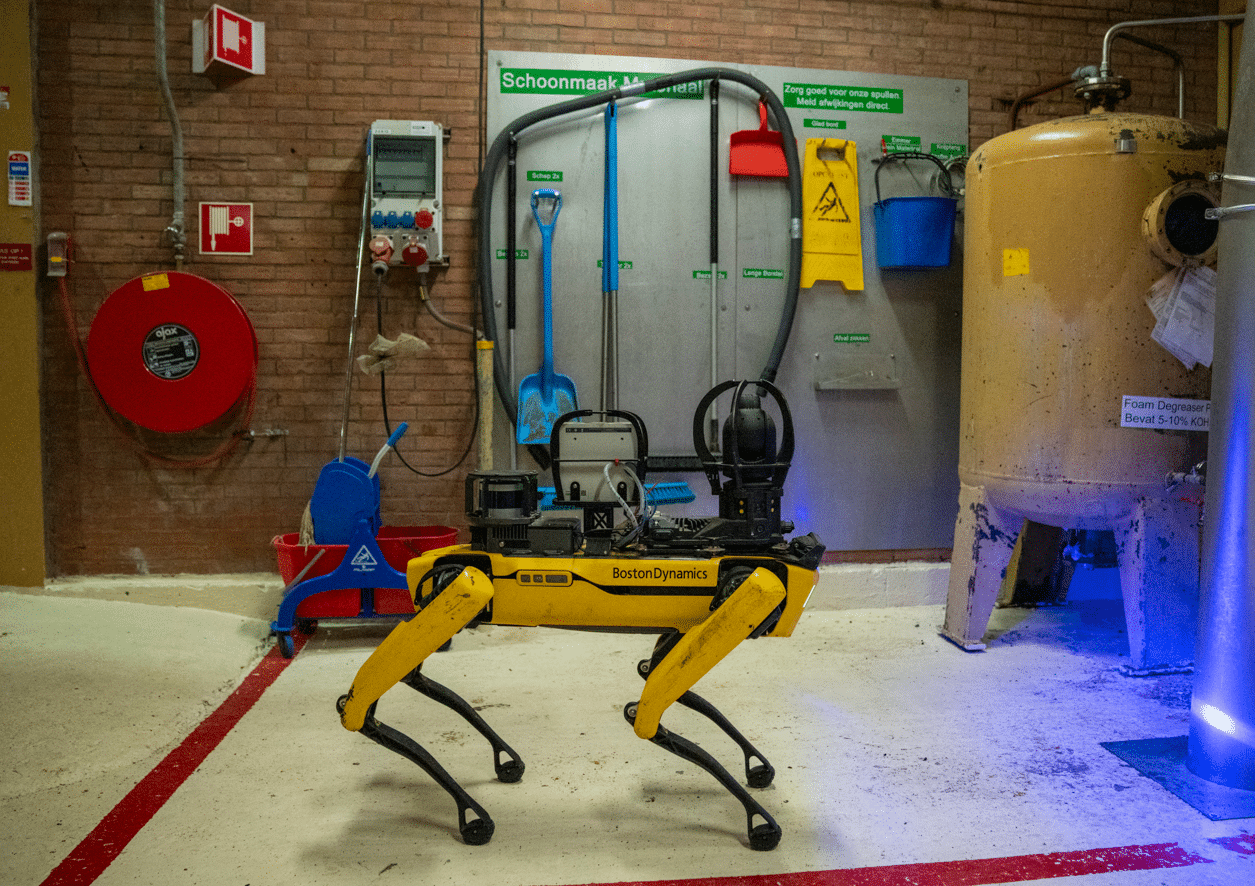

官方演示显示,Spot机器人能在工业现场自主识别危险碎片、读取压力表和视镜液位,或在家居场景中按手写清单“把鞋子放回鞋架”。这一升级建立在波士顿动力与Google DeepMind的长期合作基础上,早于2026年1月CES发布的Atlas项目合作已为此次Spot升级铺路。(来源:Boston Dynamics官方博客)(来源:DeepMind官方博客)

评论视角

Spot机器人Gemini AI集成标志着波士顿动力在四足机器人领域的战略转向:从硬件领先转向AI软硬一体化。传统巡检依赖人工编程或远程操控,而Gemini Robotics-ER 1.6作为高阶推理模型,能直接调用Spot SDK中的导航、抓取和图像采集工具,实现端到端自主决策。这一技术趋势与谷歌DeepMind在embodied AI上的积累高度契合,也让波士顿动力(现隶属现代汽车集团)在与Unitree、Figure等竞争对手的较量中,抢占工业巡检这一高壁垒赛道。

“Advances like Gemini Robotics-ER 1.6 mark an important step toward robots that can better understand and operate in the physical world. Capabilities like instrument reading and more reliable task reasoning will enable Spot to see, understand, and react to real-world challenges completely autonomously.”

—— 来源:DeepMind

影响预判

短期(6个月内):已部署AIVI-Learning的企业可立即获得零停机升级,巡检任务准确率和复杂场景适应性显著提升。工业现场(如工厂、能源设施)人力投入预计减少15-25%,危险环境巡检安全性同步提高,试点项目将快速复制至更多客户。

长期(3-5年):Spot机器人Gemini AI模式将推动机器人从“巡检工具”向“自主作业单元”演进,助力制造业应对劳动力短缺,同时加速embodied AI在物流、安防等领域的落地。但这也意味着传统巡检岗位将面临结构性调整,企业需同步投入员工再培训以实现人机协同。

常见问题解答

❓ 该事件是什么?Spot机器人Gemini AI集成的核心定义

2026年4月8日起,波士顿动力Spot机器人正式集成Google DeepMind Gemini Robotics-ER 1.6模型至Orbit AIVI-Learning平台。该升级让机器人能通过自然语言理解任务、自主进行复杂视觉分析和仪表阅读,标志着工业机器人从预编程执行迈向高阶自主推理阶段。

❓ 为什么重要?对行业和企业的影响是什么

这一集成大幅提升了Spot在真实工业环境下的适应性,减少人工干预、降低安全风险,并通过云端自动更新实现持续优化。对企业而言,可直接转化为巡检效率提升和成本节约;对行业而言,则加速了四足机器人商业化落地,巩固波士顿动力在高端机器人市场的领先地位。

❓ 接下来会怎样?行业趋势预测

短期内更多工业客户将升级部署;3-5年内,类似embodied reasoning技术有望扩展至Atlas等新一代人形机器人,推动机器人进入更非结构化场景。整体趋势是AI与机器人硬件深度融合,预计将重塑制造业劳动力结构并催生新的人机协作模式。

❓ Spot机器人Gemini AI与之前版本相比有哪些具体提升?

Gemini Robotics-ER 1.6通过agentic vision(视觉+代码执行迭代)实现仪表阅读、液位测量和多视角成功检测等能力显著优于1.5版本,支持更高阶任务规划和幻觉减少,已在AIVI-Learning中实现零停机自动升级。

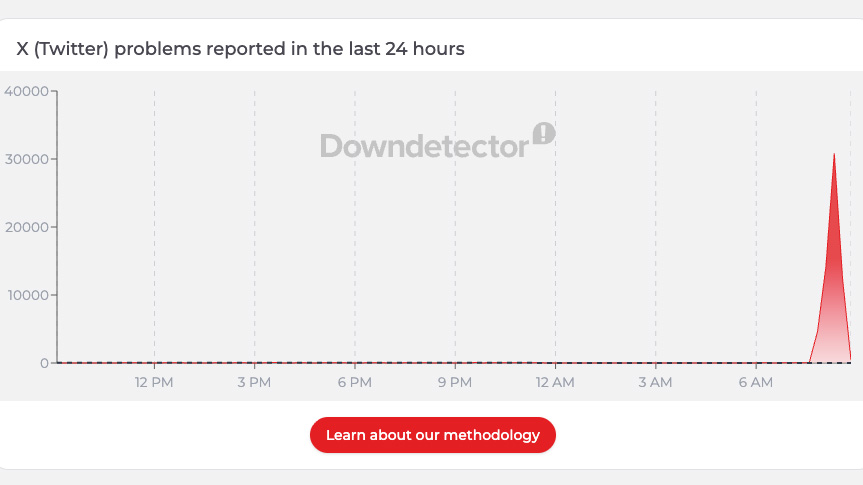

📅 本文信息更新至2026年4月16日,内容综合自X (Twitter) 实时热搜及权威科技媒体(如Boston Dynamics、DeepMind、IEEE Spectrum等)报道,仅供参考。

这下彻底完蛋了

(立场: 幽默 | 👍 17)

我做过自主机器人导航,用AI大脑实时决策。演示看起来不错,但难点永远是边缘案例。机器人看到和指令矛盾的东西时会怎样?大多数系统在那儿就崩了。好奇Gemini Robotics怎么处理真实环境中的模糊性。

(立场: 中立 | 👍 1)

Gemini Robotics装在Boston Dynamics Spot上挺可爱的,直到你意识到大多数真实转化都发生在实验室沙盒外。先把代理绕过护栏的操作者才会掌握留存层,其他人还在辩论具身安全剧场。

(立场: 反对 | 👍 2)

我宁愿家里有这个,也不想要人形机器人。😀

(立场: 支持 | 👍 1)

如果你还觉得OpenAI在任何AI竞赛中领先,那你就是在自欺欺人

(立场: 支持 | 👍 11)

太好了,现在机器人不只能拿刀杀我,还能在我把自己锁在门外时帮我开门。谢谢Google

(立场: 幽默 | 👍 7)

更好的空间推理是实用机器人技术的瓶颈。如果Gemini Robotics-ER 1.6能可靠规划物理约束下的任务,那就是向非结构化环境中真正工作的机器人迈出一大步。期待基准测试改进!

(立场: 中立 | 👍 1)

迫不及待想看到我的机器人理解物理世界到刚好意识到“把洗衣机衣服搬到烘干机不是有用任务”,然后直接罢工不干

(立场: 幽默 | 👍 3)

机器人终于开始理解真实世界而不仅仅是像素——离真正有用又近一步(说不定还要抢我饭碗😂)

(立场: 幽默 | 👍 3)